9 avril 2026

Temps de lecture : 2 min

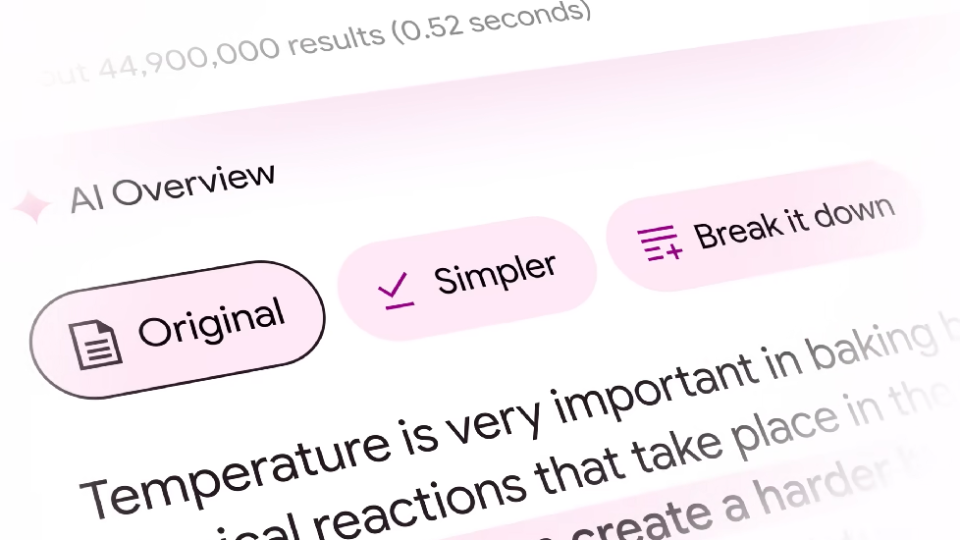

Une enquête du New York Times révèle les lacunes des Overviews de Google

Une récente analyse menée par la start-up Oumi pour le New York Times jette un pavé dans la mare concernant les AI Overviews de Google. L’outil affiche un taux d’exactitude de 91 % depuis sa mise à jour vers le modèle Gemini 3 en février (contre 85 % en octobre avec Gemini 2). Pourtant, ces chiffres doivent être mis en perspective avec l’échelle vertigineuse du moteur de recherche. Avec plus de cinq billions de requêtes traitées par an, ce taux d’erreur de 9 % se traduit par des dizaines de millions de réponses incorrectes générées chaque heure.

Le problème de « l’ancrage » (grounding) et la qualité des sources

Le rapport d’Oumi, qui s’appuie sur le test de référence SimpleQA (portant sur 4 326 recherches qui ont utilisé 5 380 sources), met en lumière la détérioration d’un indicateur clé : l’ancrage des informations. En février, 56 % des réponses exactes fournies par les AI Overviews étaient « non ancrées » (ungrounded), ce qui signifie que les sites web proposés en lien ne soutenaient pas complètement l’information générée par l’IA. En octobre dernier, ce chiffre était de 37 %.

L’analyse des milliers de sources a révélé que Facebook et Reddit sont respectivement les deuxième et quatrième sources les plus citées par l’IA. Les réponses s’appuient sur un mélange hétéroclite allant de sites de confiance à de simples publications sur les réseaux sociaux. Par exemple, pour répondre à une question sur le musée Bob Marley, l’IA a sourcé une page Facebook personnelle, un blog de voyage et une page Wikipédia contenant des informations contradictoires.

Des hallucinations persistantes et un système manipulable

Même lorsque l’IA identifie une source correcte, elle peut générer de fausses réponses ou mal les interpréter. Le test a par exemple révélé des erreurs de déduction sur la géographie d’une rivière en Caroline du Nord ou l’invention de fausses dates de décès dans la biographie du joueur de baseball Dick Drago.

L’étude révèle également que les AI Overviews sont vulnérables à la manipulation. Il suffit parfois de s’autoproclamer expert sur un blog pour tromper le système. Le journaliste de la BBC, Thomas Germain, l’a prouvé en publiant un article satirique affirmant qu’il était un champion d’un faux concours de mangeurs de hot-dogs. Dès le lendemain, l’AI Overview de Google l’affichait en tête des résultats comme une vérité absolue (et aux Etats-Unis, on ne rigole pas avec ça).

La réponse de Google

Face à cette analyse, Google s’est défendu en affirmant que l’étude comportait de « sérieuses lacunes », que le test de référence SimpleQA utilisé était lui-même imparfait, et que ces requêtes ne reflétaient pas les recherches réelles des internautes. Le géant de la tech minimise également les risques de manipulation, assurant que ses systèmes de protection bloquent la majorité du spam. Toutefois, l’entreprise inclut désormais une mention de précaution sous ses résumés, invitant les utilisateurs à revérifier les informations, comme c’est déjà le cas dans de nombreux moteurs IA.

A lire sur le sujet :

Topics

TOUS LES MATINS, RECEVEZ UNE DOSE D'ADTECH, D'EVENEMENTS, D'INNOVATIONS, MEDIA, MARKETING...

Je découvre les newsletters Minted !