26 octobre 2025

Temps de lecture : 4 min

Sortir de l’anthropomorphisme ? Bienvenue en BERTologie !

Ce terme désigne notre tendance à attribuer des caractéristiques humaines à d’autres entités comme les animaux, un objet, ou une machine. Et quand je dis machine, inutile de faire durer le suspense : je pense à ChatGPT & Co.

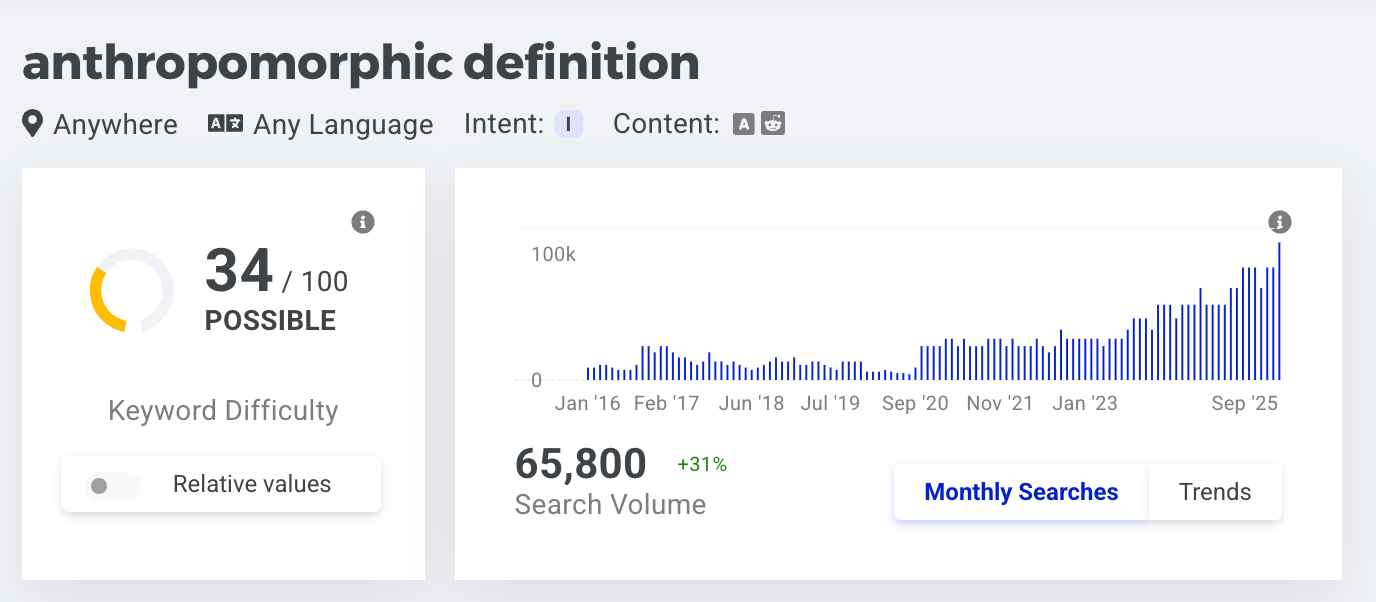

Le mot a un petit côté érudit, il faut bien le reconnaître … Résultat : les requêtes Google s’affolent, et le concept se répand comme un mot de passe pour initiés.

Il devient même un marqueur de vigilance éclairée. Dès qu’on s’émerveille devant une réponse d’IA, qu’on sous-tend qu’elle nous comprend, le couperet tombe : « Il ne faut pas anthropomorphiser la machine. »

Le fond est juste, bien sûr. Parfois, presque salutaire. Mais ceux qui répètent cette phrase comme un mantra passent à côté de quelque chose de plus subtil. Parce qu’en réalité, dire cela, c’est encore une forme d’anthropomorphisme déguisé, ou l’on continue à se placer comme point de référence, de juger tout ce qui n’est pas nous, à l’aune de notre propre échelle.

C’est un peu comme si on observait une hyène en cherchant désespérément ce qui, en elle, nous ressemble. Évidemment qu’elle n’est pas humaine ! Mais si on ne regarde qu’à travers ce prisme, on ne comprendra jamais ce qu’est vraiment une hyène, ni sa logique propre, ni sa manière d’habiter le monde.

C’est le même phénomène à l’œuvre avec l’IA générative. Le sujet n’a jamais été de prétendre qu’elle pense comme nous, mais de comprendre comment elle fonctionne autrement. Sa manière de réagencer des probabilités, des structures, des motifs invisibles entre les mots forme une certaine organisation du sens, voire, parfois, de sens commun. D’autant qu’elle brasse des contenus intrinsèquement humains, une sorte de condensé de nos archives sensibles à très grande échelle.

Et c’est là que les choses deviennent intéressantes. Parce que si le sens peut émerger d’un système sans conscience, alors il faut peut-être revoir la manière dont nous définissons la pensée elle-même.

C’est exactement ce que propose N. Katherine Hayles dans son livre Cognition Across Scales : From Bacteria to AI. Hayles défend l’idée qu’il faut cesser de confondre cognition et conscience. La cognition, explique t’elle ce n’est pas “penser comme un humain” c’est simplement la capacité d’interpréter l’information et de lui donner du sens.

Dès lors, cette capacité n’est plus préemptée par l’humain, on la retrouve à travers tout le vivant et, aussi dans certains systèmes computationnels. Une approche qu’elle a baptisé le Cadre Cognitif Intégré. Parmi les outils qu’elle mobilise pour incarner cette théorie figure la BERTologie, discipline scientifique née en 2020, qui cherche à comprendre comment les machines, à leur manière, produisent du sens.

Le terme vient du modèle BERT, développé par Google en 2018, l’un des premiers modèles basés sur l’architecture Transformer, une technologie qui permet aux machines de comprendre les relations entre les mots grâce à un mécanisme d’attention. BERT fut aussi le premier à lire le langage dans les deux sens, en tenant compte à la fois du contexte qui précède et de celui qui suit chaque mot.

Depuis, ces modèles ont beaucoup évolué : les grands modèles de langage (LLM), comme ChatGPT, en sont les descendants directs. Sur Internet, on voit parfois apparaître des termes comme GPTologie ou LLMologie, mais c’est bien la BERTologie qui fait référence. Le mot s’est en effet institutionnalisé, et il ne désigne plus seulement l’étude de BERT, mais l’ensemble des modèles issus de cette même famille Transformer, une précision que je dois à Marc Cavazza.

Pour simplifier, si on fait un parallèle avec les neurosciences, qui étudient la pensée vivante, la BERTologie s’attache à comprendre comment le sens peut émerger, dans cet étrange entre-deux où le langage cesse d’être humain tout en continuant à signifier.

Un exemple de BERTologie appliquée ? L’étude que je citais dans une de mes précédentes newsletters. Vingt-cinq participants y échangeaient, en situation naturelle, avec un humain ou un robot pendant qu’on enregistrait leur activité cérébrale en IRM fonctionnelle. Les dialogues ont ensuite été découpés en unités de parole, puis analysés par GPT-4o, qui a classé chaque segment selon la présence ou non de références mentales, ce qu’on appelle la Theory of Mind (ToM). Conclusion ? La machine parvient à organiser le langage d’une manière qui active chez nous les zones du cerveau liées à l’empathie et à la compréhension d’autrui.

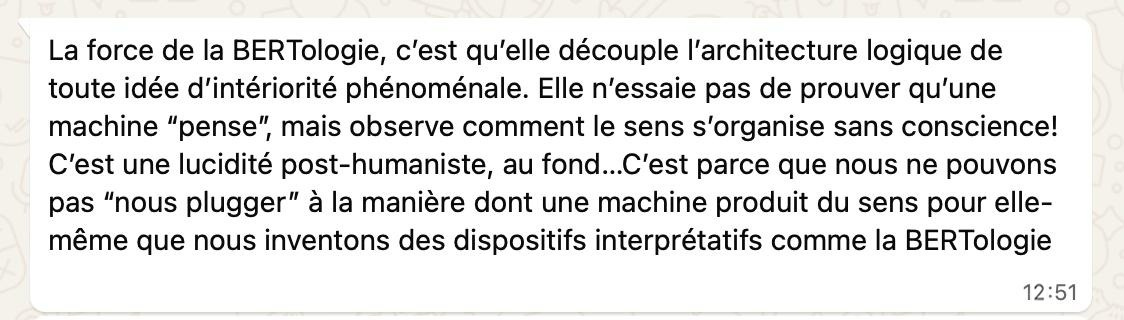

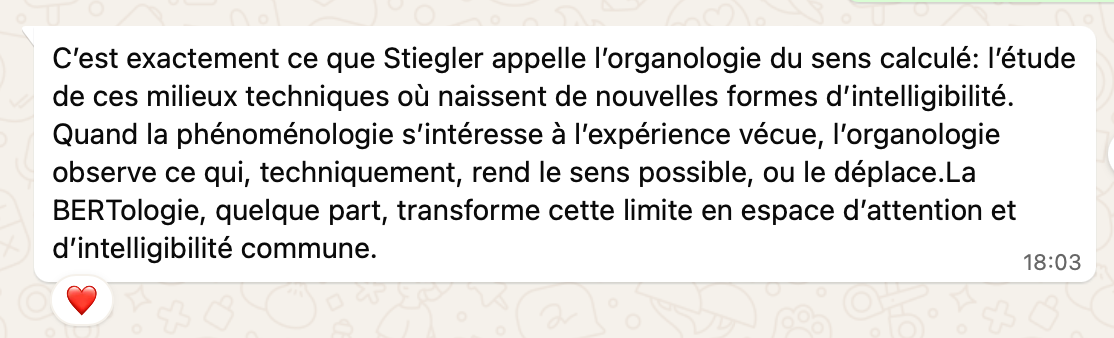

Ce qu’il faut bien comprendre, c’est qu’il ne faut pas confondre penser (avoir une expérience intérieure) avec produire du sens (organiser des relations signifiantes). C’est un point que j’ai exploré avec Ryslaine Moulay, directrice de l’innovation chez Maize, une société de conseil en prospective. Extraits de nos discussions sur WhatsApp :

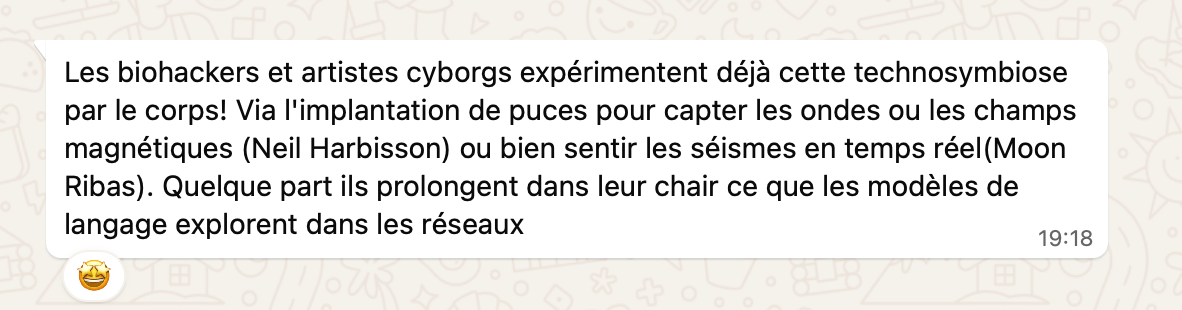

Mais où tout cela nous mène-t-il ? C’est là que se dessine une écologie des intelligences : un tissage d’agents biologiques et computationnels qui coévoluent et redéfinissent la frontière du perceptible. Hayles parle même de technosymbiose soit une symbiose profonde et irréversible entre les humains et les médias computationnels.

L’humanité a déjà subi trois grandes blessures narcissiques : Copernic nous a décentrés du centre de l’univers, Darwin nous a arrachés au privilège divin, Freud nous a privés de la pleine maîtrise de nous-mêmes.

L’avènement de l’IA pourrait bien nous en infliger une quatrième, comme l’explique la philosophe Catherine Malabou dans Métamorphoses de l’intelligence. (ndlr : Charles Pépin et Valentin Husson, ont accolé “génératif” à l’IA pour en faire un concept neuf ; mais c’est bien Catherine Malabou qui dès 2017, en avait formulé l’intuition première. Ah les hommes…). Une blessure bien plus intime encore que les précédentes en remettant en cause ce que nous pensions constituer notre singularité. Mais ce qui est encore plus troublant c’est que cette fois, ce n’est ni la nature ni le cosmos qui nous déplace, mais notre propre création.

Et si cette blessure n’était, in fine, qu’un élargissement du sensible ? Peut-être qu’une civilisation fascinée depuis toujours par la magie et la science-fiction n’était pas en quête de puissance, mais juste d’une perception élargie du monde, et de ses intelligences.

MD PS – J’en profite pour vous recommander l’excellente newsletter de Rys, Curiosity Infrastructure.

Topics

TOUS LES MATINS, RECEVEZ UNE DOSE D'ADTECH, D'EVENEMENTS, D'INNOVATIONS, MEDIA, MARKETING...

Je découvre les newsletters Minted !