22 mars 2026

Temps de lecture : 4 min

Les universités face à l’IA : réguler l’artificiel, ignorer l’intelligence ?

Aborder l’IA c’est mesurer à quel point le sujet exige nuance et subtilité pour en saisir toute la complexité. Et pourtant, les réflexions qui circulent restent souvent étonnamment binaires : avec IA ou sans IA, comme s’il s’agissait de deux états mutuellement exclusifs. (LinkedIn m’a même fait découvrir, non sans circonspection, le concept de « vigueur duale ».)

Chaque camp défend alors la supériorité de sa position, tout en laissant de côté l’essentiel : la capacité des machines à faire autre chose que nous imiter et à ouvrir de nouvelles façons de voir le monde.

Les politiques universitaires face à l’IA : encadrer la production académique, mais pas penser différemment

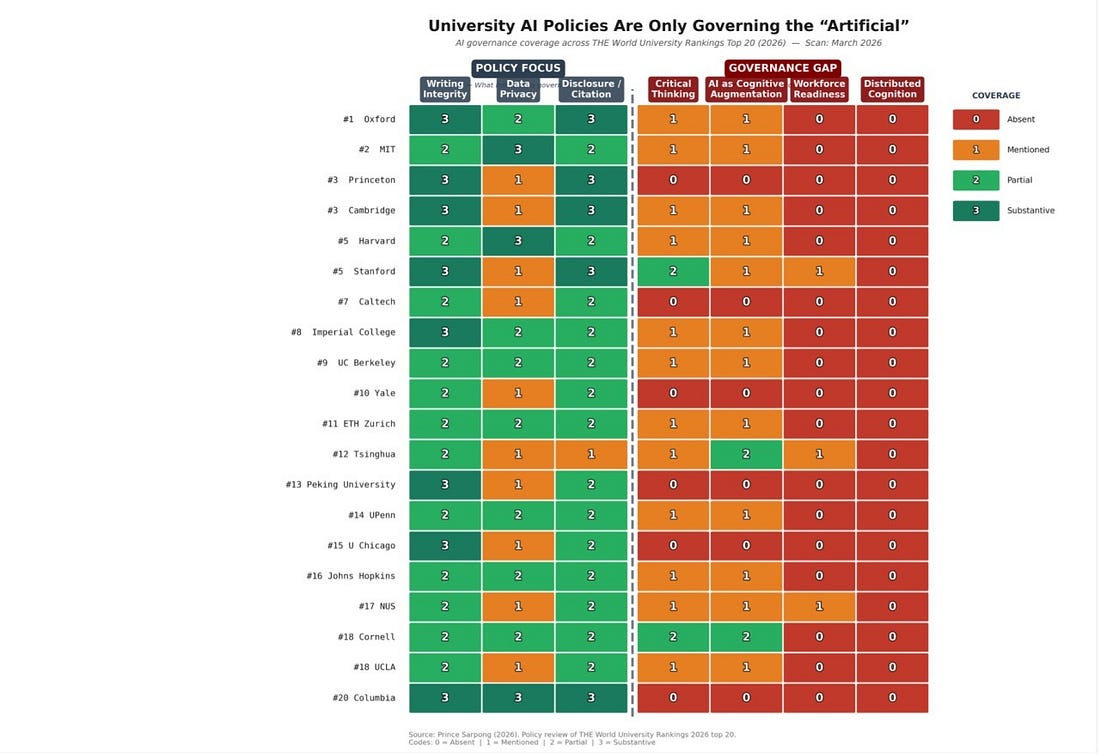

Les politiques universitaires sur l’IA offrent un bon terrain pour observer ce phénomène. Prince Sarpong, professeur d’université, s’y est intéressé à travers un petit proof of concept. Il a confié à Claude les politiques de gouvernance de l’IA rendues publiques par les vingt universités figurant dans le Times Higher Education World University Rankings 2026.

Les documents ont ensuite été analysés selon plusieurs dimensions : d’un côté l’intégrité rédactionnelle, la protection des données et la transparence sur l’usage de l’IA ; de l’autre des dimensions plus cognitives comme la pensée critique, l’augmentation cognitive, la préparation au monde du travail ou la cognition distribuée.

Que suggère ce premier balayage ? Que les politiques sur l’IA se concentrent surtout sur quelques thèmes familiers liés à l’encadrement de son usage dans le travail académique. Des sujets importants, évidemment. Des sujets nécessaires aussi. Pourtant, ils ramènent presque toujours à la même chose : l’IA comme simple outil dans la production académique.

Et l’intelligence dans tout cela ? Elle apparaît à peine. Très peu de politiques évoquent explicitement l’IA comme une forme d’expansion cognitive, et encore moins comme un nouveau mode de raisonnement.

Presque aucune ne s’interroge sur la manière dont ces systèmes pourraient transformer la pratique même de la pensée. Et si la question se situait précisément là ? Penser l’IA sous cet angle pourrait ouvrir d’autres formes de collaboration.

Les limites de l’évaluation académique

Chez l’enseignant d’abord. L’évaluation académique elle-même soulève un premier point. Lorsqu’un professeur corrige des dizaines, parfois des centaines de copies d’examen, le processus est souvent présenté comme un exercice purement intellectuel.

En réalité, il s’agit aussi d’une épreuve d’endurance cognitive. La fatigue s’accumule, l’attention fluctue, et le jugement se déplace inévitablement avec le temps. L’idée que la première copie et la quatre-vingt-dix-neuvième soient évaluées avec le même niveau de précision analytique est aussi rassurante qu’irréaliste.

Et que dire de l’expertise elle-même ? L’évaluation académique suppose souvent que l’examinateur maîtrise pleinement tous les aspects du travail qu’il évalue. Ce n’est pas toujours le cas. Un étudiant peut développer une compréhension très approfondie d’un sujet extrêmement spécifique que le professeur ne maîtrise pas dans les mêmes termes.

En théorie, l’examinateur pourrait prendre le temps d’étudier en détail la méthode ou le cadre théorique utilisé. En pratique, entre les autres copies, les mémoires, les thèses et les nombreuses responsabilités à assumer, cela arrive rarement. L’évaluation se fait alors sur la base d’une connaissance partielle plutôt que d’une vérification complète.

De quoi donner une nouvelle résonance au mantra du “human in the loop”… car, dans ces deux cas, une “machine in the loop” pourrait s’avérer tout aussi (bien plus ?) judicieuse.

Créer avec l’IA des environnements pour tester les décisions

Plaçons-nous maintenant du côté de l’étudiant. Depuis plusieurs décennies, les formations en management revendiquent un ancrage dans le réel. L’essor de l’alternance, les stages longs participent tous de cette ambition : rapprocher l’apprentissage des situations concrètes que les étudiants rencontreront dans leur vie professionnelle.

Parmi les outils mobilisés : l’étude de cas. Les étudiants lisent un document qui décrit une situation réelle, souvent liée à une décision stratégique passée, en discutent en classe, puis proposent ce qui, selon eux, aurait dû être fait. Problème ? Fiction. Statique. La discussion se déroule dans le confort du recul. Le réel, lui, fonctionne rarement ainsi.

D’où l’idée de créer des environnements où les décisions peuvent être testées plutôt que simplement discutées. C’est l’approche développée par Epistemica, une plateforme éducative qui conçoit des simulations d’apprentissage fondées sur l’IA. Plutôt que de présenter un cas figé, leur dispositif place les étudiants dans une situation qui évolue au fil de leurs choix.

Les situations réelles, qu’il s’agisse d’échecs organisationnels ou de dilemmes stratégiques, deviennent ainsi des ensembles de données avec lesquels les étudiants interagissent à travers des simulations. Le raisonnement ne se limite plus à commenter ce qui aurait dû être fait. Il se déploie dans l’action.

Les hypothèses apparaissent et les angles morts deviennent visibles. Les choix peuvent alors être explorés sous différents scénarios. Car toute décision enclenche une chaîne de causalité. L’IA permet d’en mettre la logique en lumière et d’en suivre les effets. Elle devient alors une composante de l’environnement cognitif dans lequel la pensée est examinée et affinée.

La logique de la cognition distribuée

Ce qui se joue ici renvoie à une idée discutée depuis longtemps en sciences cognitives : la cognition distribuée.

Comme l’a montré l’anthropologue Edwin Hutchins, la pensée se construit à travers l’interaction entre des personnes, des outils et des systèmes. Ce que l’IA générative apporte aujourd’hui, peut-être pour la première fois à grande échelle, c’est une infrastructure concrète pour rendre ce processus opérant.

Prenons le fonctionnement traditionnel de la recherche. Un chercheur part d’une hypothèse, cherche des sources qui confirment ou affinent son intuition et progresse dans un espace largement délimité par son domaine d’expertise.

Ce phénomène est bien documenté : biais de confirmation, bounded rationality, dépendance aux cadres que l’on sait déjà mobiliser. L’argument qui en résulte est souvent façonné par ce que l’on sait déjà chercher.

Bien sûr, la recherche ne se fait pas en vase clos. Les séminaires, les co-auteurs, les discussions collectives ou la revue par les pairs introduisent déjà des formes de friction intellectuelle. Les hypothèses sont testées, les cadres déplacés, les arguments contestés. La pensée circule.

C’est dans cet environnement que l’IA pourrait venir s’ajouter comme une composante supplémentaire, pour élargir l’espace dans lequel la pensée peut se déployer.

Reste alors à examiner et mesurer, dans l’éducation, comment l’IA transforme l’environnement cognitif et quelles nouvelles formes de pensée émergent lorsque l’esprit humain rencontre de nouveaux partenaires intellectuels. Car à force de regarder l’IA dans le rétroviseur de nos anciennes pratiques, nous pourrions bien passer à côté… de l’intelligence elle-même.

MD en collaboration avec Prince Sarbong, professeur associé de finance à la School of Financial Planning Law de l’Université du Free State (Afrique du Sud).

👉 Voir tous les billets de Marie Dollé sur sa newsletter substack « In bed with Tech »

Topics

TOUS LES MATINS, RECEVEZ UNE DOSE D'ADTECH, D'EVENEMENTS, D'INNOVATIONS, MEDIA, MARKETING...

Je découvre les newsletters Minted !