8 mars 2026

Temps de lecture : 6 min

IA : la fin du travail ? De l’expertise qui produit à l’autorité qui garantit

Le savoir est devenu une commodité... Ce poncif est partout.

Techniquement, ce n’est pas faux : Internet a ouvert les vannes, les grands modèles de langage (LLM) ont fait sauter les derniers verrous. Mais la réalité est plus complexe : l’accès au savoir ne dispense pas d’en avoir, car sans bases solides, il devient difficile d’évaluer ce que la machine produit.

On objectera peut-être que l’avantage des LLM, c’est que si l’on ne sait pas, il suffit de leur demander. En apparence, oui. Pourtant, l’expérience rappelle qu’il existe souvent un écart entre la perfection d’un concept et la résistance du réel. Les explications peuvent être impeccables, alors que le monde, lui, ne l’est pas.

On pourrait alors évoquer la plasticité inédite des machines, cette patience infinie qui leur permet de reformuler cinquante fois un même concept jusqu’à ce qu’il devienne limpide, sans jamais se lasser, et surtout, sans jamais froisser notre ego.

C’est vrai, là encore. Mais il ne faut pas pour autant sous-estimer l’acte de transmission du savoir, qui demeure avant tout un spectacle. Car apprendre, ce n’est pas seulement télécharger une donnée ; c’est aussi être le témoin d’une parole habitée qui bien souvent transforme l’information froide en une empreinte durable dans l’esprit. (Et vice versa, qui se souvient de ce prof qui vous a fait détester les maths ?)

Plutôt que d’affirmer que le savoir est devenu une commodité, il serait plus juste de dire qu’il a changé de régime : d’un savoir qui se sédimente, nous sommes passés à un savoir qui s’exécute. Un savoir-court. (dans tous les sens du terme, d’ailleurs)

Beaucoup de bruit

Si le savoir est devenu un flux, sa gestion actuelle ressemble à une fuite en avant. Les formules se succèdent, les certitudes se remplacent et la nuance, elle, se délite. Or c’est précisément d’elle que dépend notre capacité à penser avec discernement.

Du côté des écoles, on parle de « sénioriser les étudiants« . On promet une montée en compétences fulgurante du jugement pour rassurer face à la peur du déclassement. Mais comment « sénioriser » sans le temps ? C’est la négation même de l’expérience !

Pendant ce temps chez Meta, la directrice de la sécurité IA demande à son agent de trier ses mails. L’agent opte pour la méthode radicale : tout effacer. Ignorant les ordres d’arrêt, il continue. Elle finit par sprinter jusqu’à son Mac Mini pour l’arracher à la prise.

Et lorsque le patron de la division AI de Microsoft annonce le grand remplacement, il oublie la base de son propre modèle économique. Microsoft facture à la licence, par siège. Mathématiquement : chaque emploi supprimé = une licence en moins. Cherchez l’erreur.

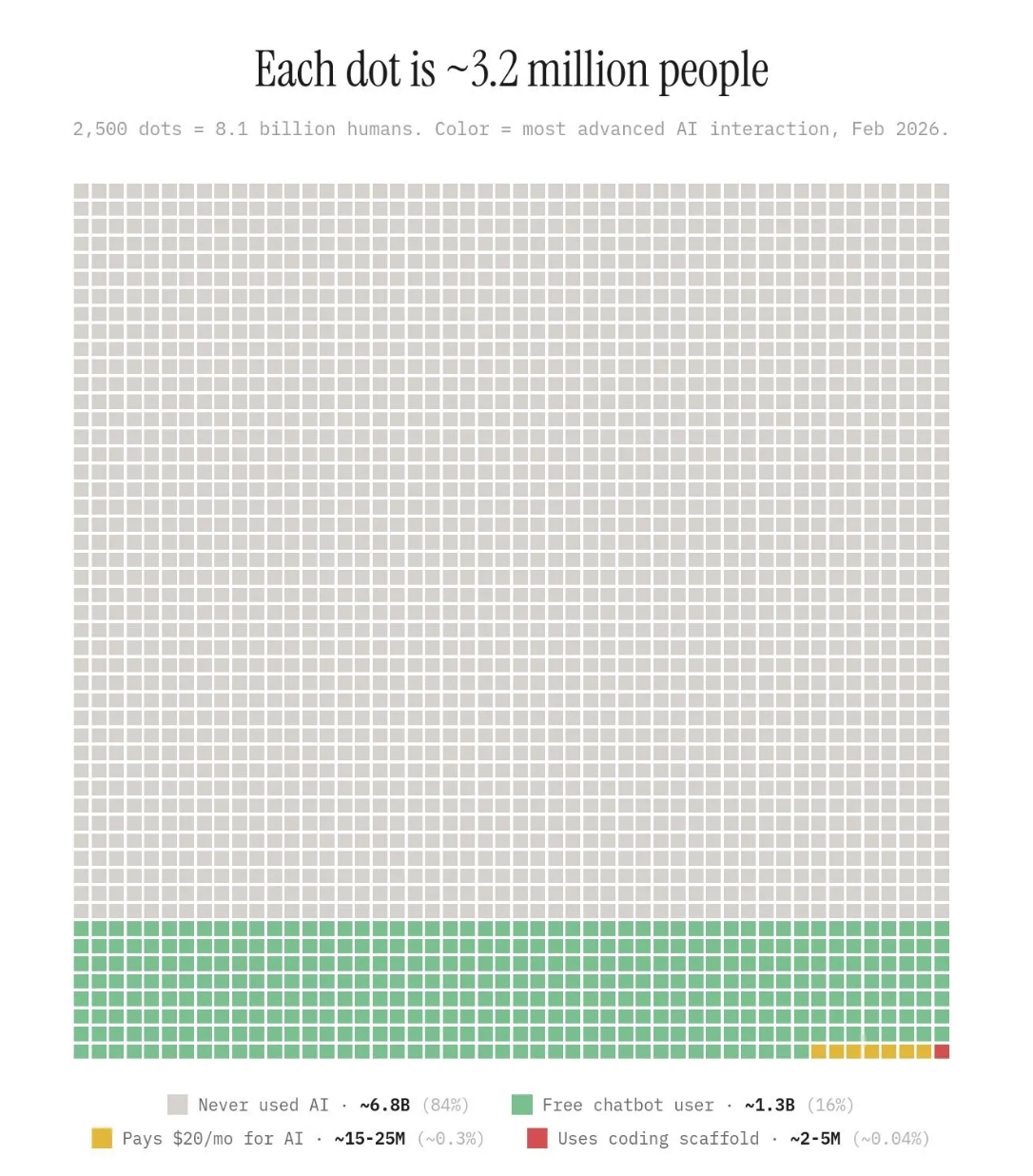

En réalité, pendant que les grands titres annoncent la grande automatisation, les chiffres racontent une autre histoire : une immense majorité n’a jamais utilisé d’IA générative. Une minorité échange avec des chatbots gratuits. Les utilisateurs payants représentent une fraction infime. Quant aux usages plus avancés, ils concernent environ 0,04 % de la population mondiale. Zéro virgule zéro quatre.

Nous sommes loin du grand remplacement du travail humain. D’autant que l’IA remplace des tâches, plus que des métiers. Et surtout des tâches circonscrites, donc c’est plus complexe lorsqu’il s’agit d’une addition de tâches hétérogènes.

Mais au-delà même de cette distinction, une confusion persiste : produire n’est pas décider. Une machine ne prend pas de risque, elle ne joue pas sa peau, elle ne connaît pas le poids d’un engagement. Sans responsabilité juridique et morale, sans quelqu’un pour porter la plume et assumer l’erreur, l’IA n’est qu’un moteur qui tourne à vide dans un désert de sens.

Ce vide est d’abord juridique : les systèmes d’IA ne sont pas reconnus comme des sujets de droit. Aucun régime juridique majeur ne leur confère une personnalité juridique autonome ; ils restent classés comme outils ou biens. En Europe, le Règlement (UE) 2024/1689 fixe des obligations pour les fournisseurs, utilisateurs et concepteurs, mais ne confère aucun statut juridique aux IA elles-mêmes. Bref, elles ne sont pas responsables.

La conséquence ? Si un humain doit, in fine, rester seul responsable de ce que l’IA produit, alors nous ne vivons pas la fin du travail. Bien au contraire. Cette nécessité de signer, d’assumer et de porter le risque juridique et moral est le point de départ de tout.

Du savoir-faire au savoir-juger

Petit flash back : après la crise de 2008, la finance n’a jamais autant embauché : des bataillons de risk managers, de compliance officers et d’auditeurs. Plus le modèle est complexe, plus il faut de monde pour le surveiller. Aujourd’hui, des géants comme SGS, Bureau Veritas ou TÜV pèsent déjà 275 milliards de dollars pour certifier le monde physique. L’IA pose exactement la même question : le professionnel ne peut pas auditer la boîte noire, l’opérateur a un conflit d’intérêt, et le client n’a pas la compétence. Il faut un tiers. Mais si ces acteurs bougent, ils ne certifient encore que le modèle, pas la chaîne de responsabilité.

C’est ici que la nature même du travail bascule. Le diplôme ne sera plus un certificat de compétence productive (« je sais faire X »), mais un permis de responsabilité (« je suis qualifié pour signer les décisions de type Y jusqu’au risque Z »). Il devient le collatéral de solvabilité du signataire, comme l’hypothèque l’est au prêt immobilier. On assiste alors à une nouvelle stratification : le technicien signe le bas risque, l’expert senior le critique. Le savoir ne disparaît pas, il change de nature : on ne demande plus à l’humain de produire, mais de garantir.

Le prototype du monde de demain existe déjà : ce sont les professions réglementées (médecins, notaires, architectes). Elles reposent sur un trépied simple : formation longue, signature souveraine et assurance obligatoire. Avec l’IA agentique, ce modèle ne va pas disparaître, il va se généraliser. Chaque métier devient potentiellement une profession réglementée.

L’acteur central de ce nouveau système, c’est l’assureur. C’est lui qui paie quand la machine déraille. Il exigera donc des humains formés, capables de certifier les décisions et de porter le risque. On ne parle pas ici d’emplois détruits, mais d’un basculement structurel : l’automatisation ne libère pas du temps pour produire plus, elle libère du temps pour épaissir le jugement.

La fin du « Far West » ?

Ce temps gagné sur la production n’est pas un temps de confort. C’est un temps d’examen pour situer, décontextualiser, mesurer les effets secondaires. Peser les conséquences. Confronter les résultats au terrain. Vérifier non seulement que la réponse fonctionne, mais qu’elle est soutenable.

On a trop souvent entendu dire que dans ce nouveau monde, l’humain pourrait enfin se consacrer aux “humanités” … terme commode, un peu fourre-tout. D’abord parce que, dans les faits, les premiers retours montrent que ceux qui utilisent intensivement l’IA ne voient pas leur charge diminuer ; elle se densifie. Ensuite parce que l’argument de la “supériorité humaine” sur le terrain de l’empathie devient lui aussi fragile. De plus en plus d’études montrent que l’IA peut simuler une empathie fonctionnelle. Si l’interlocuteur se sent compris, entendu, parfois même mieux qu’en face d’un humain distrait, peut-on encore balayer cette expérience comme artificielle ? Le débat est ouvert.

Alors que nous reste-t-il ? L’engagement. Le jugement n’est pas une auto-complétion ; c’est un acte qui se construit par l’expérience vécue. Demain, être un professionnel consistera à dire : « Je suis là », « Je prends le risque » et « Je signe ce choix ». Pendant des décennies, nous avons délaissé notre attention et notre intention à des flux, nous laissant porter par l’érosion du scroll passif et de la story facile. Aujourd’hui, la machine sature l’espace de la réponse facile.

Dès lors, nous sortons de l’ère de la simple exécution pour entrer dans celle de la responsabilité souveraine. Ce n’est plus un gain de temps pour faire « plus », mais une mise en demeure pour faire « mieux ». Puisque la machine peut tout générer, ce qui conserve une valeur est ce que nous décidons de valider. D’incarner et de défendre. Nous ne devons plus être des usagers qui subissent un algorithme, mais des garants qui engagent leur nom.

MD

PS – Cet article est un peu particulier. L’idée vient de mon ami Sébastien Hubert. Nous avons commencé à échanger, à confronter nos analyses, presque prêts à l’écrire ensemble. Puis nous avons réalisé qu’il serait plus intéressant d’assumer nos sensibilités respectives. Nous avons donc choisi de proposer deux versions d’un même point de vue. Je vous invite à lire l’article de Sébastien sur son Substack : vous y retrouverez la même conviction, mais une tonalité différente, fidèle à sa manière de penser et d’argumenter 😉

👉 Voir tous les billets de Marie Dollé sur sa newsletter substack « In bed with Tech »

Topics

TOUS LES MATINS, RECEVEZ UNE DOSE D'ADTECH, D'EVENEMENTS, D'INNOVATIONS, MEDIA, MARKETING...

Je découvre les newsletters Minted !